«Черкаські медійники активно використовують штучний інтелект для різноманітних завдань, підвищуючи ефективність своєї роботи і якість контенту». Таким був би мій блог, аби його писала не я, а ChatGPT. Адже саме таку відповідь штучний інтелект дав на моє питання про те, як же черкаські журналісти його використовують. Вже в наступному абзаці ChatGPT надає аж шість способів, як черкаські редакції нібито вже зараз використовують ШІ.

Так використовують ШІ черкаські редакції за версією самого штучного інтелекту. Скріншот із ChatGPT‐4

Спілкування із черкаськими медійниками натомість показало, що, насправді, вони, здебільшого, лише вивчають можливості штучного інтелекту і, радше, експериментують з ним, аніж впроваджують у рутинну роботу.

Схожа ситуація і на рівні всієї України. Згідно з нещодавнім опитуванням Інституту масової інформації, лише 22% українських редакцій використовують штучний інтелект на постійній основі. 30% опитаних зазначили, що в їхній редакції зрідка залучають ШІ. Кожен п’ятий журналіст не використовує інструменти ШІ у своїй роботі. А 16% опитаних раніше користувалися інструментами ШІ, але наразі припинили.

Корпоративні правила Суспільного

За словами Нині Волощук, Суспільне Черкаси наразі не використовує штучний інтелект у своїй роботі. «Ми готові поширювати тільки практики відповідального використання ШІ, адже довіра аудиторії дуже цінна для команди. Тому, перш, ніж широко впроваджувати інноваційні технології, – ми їх вивчаємо, аналізуємо ризики і лише тоді беремо в роботу, як інструмент покращення виробничих процесів», – зазначає шеф‐редакторка Суспільне Черкаси і центрального хабу Суспільного.

Нині інструменти ШІ для розшифрування аудіо/відео, перекладу, озвучування, субтитрування тестують команди центрального офісу Суспільного. Згодом Суспільне планує розповсюдити їх і у місцевих підрозділах. Вже зараз у редакції розроблені корпоративні принципи використання штучного інтелекту. Вони опубліковані на сайті медіа.

Задекларовані приципи, зокрема, передбачають, що Суспільне не використовуватиме інструменти ШІ, які:

- несуть потенційні ризики для подання інформації та можуть призвести до створення «інформаційних бульбашок», поляризації суспільства, упередженості та ін.;

- суперечать стандартам журналістики;

- суперечать стратегії, річному плану Суспільного;

- невиправдані з погляду ресурсів та часу.

Барбі‐редакція «Вичерпно»

Редакція «Вичерпно» кілька разів тестувала створення штучним інтелектом заголовків. Результат був непоганим, ділиться головна редакторка медіа Анна Романенко. «Це були авторські матеріали і чогось всі наші ідеї здавалися банальними. Тож, звернулися до чату GPT. З того, що нам запропонував штучний інтелект, пригадую, нам сподобалися окремі словосполучення, які ми й використали в заголовках», – додає Анна.

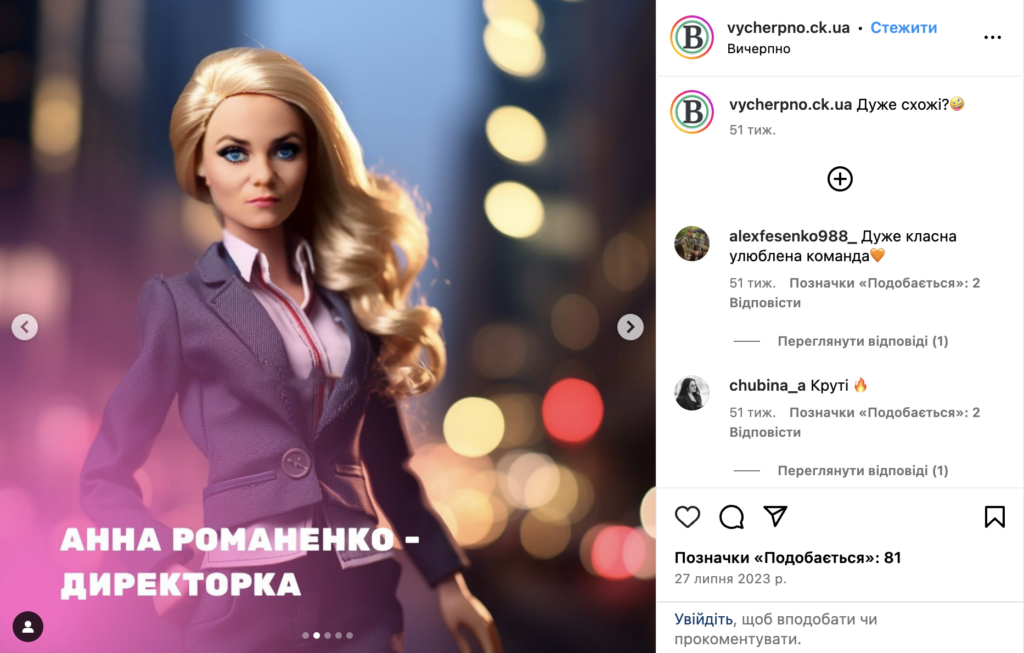

Окрім того, за допомогою штучного інтелекту редакція генерувала серію зображень, який вигляд мала би редакція «Вичерпно», якби її члени були Барбі й Кеном. «Таким чином трохи розбавили наші сторінки в соцмережах веселим контентом», – каже головна редакторка медіа.

Скріншот із інстаграму «Вичерпно»

Вигаданий батько у розслідуванні «18000»

Редакція сайту «18000» найактивніше використовує штучний інтелект для транскрибування аудіофайлів. За словами редакторки відділу новин Вікторії Нянько, це дозволяє суттєво економити час, зокрема, для розбивання відео по таймкодах в YouTube. Окрім того, редакція використовує ШІ для транскрибування аудіофайлів під час створення текстових публікацій, проте, здебільшого, щоб знайти потрібний фрагмент і вже вручну його розшифрувати.

Одного часу видання використовувало ШІ і для створення відеорозслідування. Темою матеріалу були ворожки, які заробляють на рідних загиблих чи зниклих безвісти військових. Тоді журналістка Ірина Малюкова провела експеримент: ходила до представниць цієї «професії» з легендою про зниклих на війні батька і дядька.

«Щодо останнього ми брали фото мого справжнього дядька, який загинув на початку повномасштабної. А замість фото тата – згенероване ШІ. Тобто фото людини, якої взагалі не існує, різні пошуковики по обличчях це нам підтвердили. На диво, ворожки бачили цю «людину» то пораненою в лікарні, то пораненю в якомусь підвалі, то полеглою на полі бою. Саме описування ворожками тяжких боїв і травм людини, якої не існує, додало матеріалу більшої доказовості шахрайських дій», – розповідає ІМІ Ірина Малюкова.

Журналістка Ірина Малюкова та фото її «батька», згенероване ШІ. Скріншот із розслідування «18000»

Також Ірина використовує ШІ і для транскрибування відео. «Інколи герої наших розслідувань у намаганнях відбілитися можуть говорити годину. Під час запису ти подумки обираєш ключові слова фрази, яка тобі потрібна, а після транскрибування аудіо в текст за кілька секунд знаходиш ці слова за допомогою пошуку по сайту. Це забрало в нас години переслуховування «води»», – каже розслідувачка «18000».

Редакції, які поки не використовують ШІ

Редактори видань «Про все» та «Zmi.ck.ua» зазначили ІМІ, що поки що не використовують штучний інтелект у своїй роботі. Головред останнього Сергій Стасько зазначив, що нині більше зосереджений на забезпеченні редакції світлом, тож, не час для експериментів.

Гендиректор телеканалу «ВІККА» Сергій Кузляєв, натомість, розповів, що редакція кілька разів намагалася використовувати штучний інтелект у роботі, проте кейси були невдалими. «Ми пробували використовувати ChatGPT – ставили питання для матеріалів – відповіді були некоректні і неправильні. Крім того, пробували роботи відео, прописували технічне завдання, наприклад, на військову тематику. Результат був також незадовільним», – згадує Сергій.

Зараз редакція також роздумує над створення цифрової ведучої новин. Проте поки що ця ідея в розробці. Нагадаємо, що 1 травня подібного аватара вже представило Міністерство закордонних справ України.

Єлєна Щепак, регіональна представниця ІМІ в Черкаській області

Написання цього блогу стало можливим завдяки підтримці американського народу, що була надана через проект USAID «Медійна програма в Україні», який виконується міжнародною організацією Internews. Зміст матеріалів є виключно відповідальністю ГО »Інститут масової інформації» та необов’язково відображає точку зору USAID, уряду США та Internews.