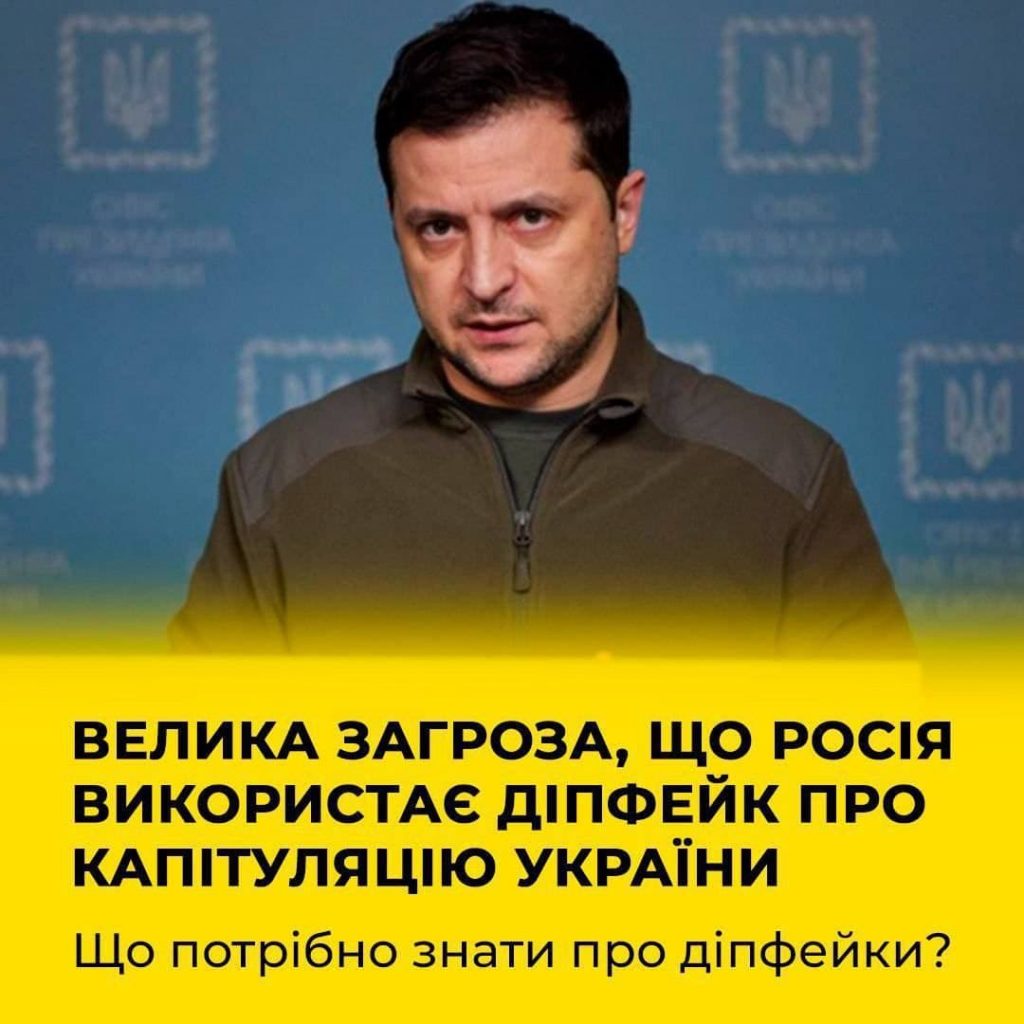

РФ може використати фейкове відео із президентом України, який нібито говоритиме про капітуляцію.

Про це повідомили в телеграм‐каналі Верховної Ради.

«Ви бачите його, ви чуєте його – а отже, це правда. Але це не правда. Це технологія діпфейк. Це буде не справжнє відео, а створене через алгоритми машинного навчання. Відео, зроблені через такі технології, майже не можливо відрізнити від реальних. Його мета – дезорієнтувати, посіяти паніку, зневірити громадян і схилити наші війська до здачі», – йдеться в поясненні.

Технологія Діпфейк (англ. deepfake; поєднання слів deep learning («глибинне навчання») та fake («підробка») — методика синтезу зображення людини, яка базується на штучному інтелекті. Її використовують для поєднання і накладення одних зображень та відео на інші зображення або відеоролики.

На практиці ж це означає, що комп’ютерні алгоритми навчилися «оживляти» фотографії, синтезувати голос людини, замінювати обличчя на певному відео. У результаті утворюється контент, зовні який майже не відрізняється від реального.

Також новини «18000» є в Telegram і Viber, слідкуйте за нами в Instagram.